گتی ایماژ

گتی ایماژاین «مشکل مهمانی کوکتل» ابدی این است که در اتاقی پر از مردم با یک نوشیدنی در دست بایستید و سعی کنید آنچه را که مهمانتان میگوید بشنوید.

در واقع، انسان ها در صحبت کردن با یک نفر در حالی که صداهای رقیب را فیلتر می کنند، به طرز قابل توجهی مهارت دارند.

اما از قضا، این مهارتی است که فناوری تا همین اواخر قادر به تکرار آن نبوده است.

و این در مورد استفاده از شواهد صوتی در پرونده های قضایی مهم است. صداهای موجود در پسزمینه میتوانند اطمینان یافتن از اینکه چه کسی صحبت میکند و چه چیزی گفته میشود دشوار میکند، که میتواند ضبطها را بیفایده کند.

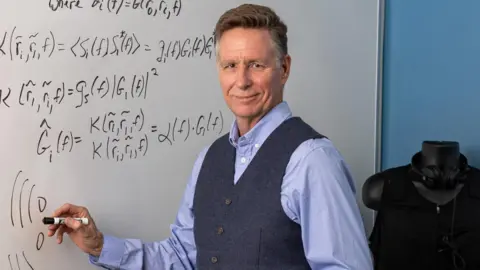

مهندس برق، کیت مک الوین، بنیانگذار و مدیر ارشد فناوری Wave Sciences، در حین کار برای دولت ایالات متحده در مورد جنایات جنگی به این مشکل علاقه مند شد.

«ما سعی کردیم بفهمیم چه کسی دستور کشتار غیرنظامیان را صادر کرده است. برخی از شواهد شامل ضبط صداهایی بود که همزمان با هم صحبت میکردند – و او میگوید که آن زمان بود که فهمیدم «مشکل مهمانی کوکتل» چیست.

“من توانستم سر و صدایی مانند ماشین، تهویه مطبوع یا پنکه را از سخنرانی حذف کنم، اما وقتی شروع به حذف نویز از سخنرانی کردم، معلوم شد که نه تنها یک مشکل بسیار دشوار است، بلکه یکی از مشکلات سخت کلاسیک است. . در آکوستیک

“صداها در اتاق به گوش می رسد، و از نظر ریاضی فهمیدن آن افتضاح است.”

پل چنی

پل چنیاو گفت که پاسخ این بود که از هوش مصنوعی برای شناسایی دقیق و فیلتر کردن تمام صداهای رقیب بر اساس جایی که در ابتدا از اتاق آمده اند استفاده کنیم.

این فقط به معنای افراد دیگری نیست که می توانند صحبت کنند – همچنین میزان قابل توجهی تداخل از نحوه انعکاس صداها در اتاق وجود دارد که صدای گوینده مورد نظر به طور مستقیم و غیر مستقیم شنیده می شود.

در ناخوشی کامل دوربین – یکی کاملاً عاری از اکو – یک میکروفون روی بلندگو برای درک آنچه همه میگویند کافی است. اما در یک اتاق واقعی، مشکل به یک میکروفون برای هر صدای منعکس شده نیز نیاز دارد.

آقای McElveen در سال 2009 Wave Sciences را به امید توسعه فناوری که بتواند صداهای همپوشانی را از هم جدا کند، تأسیس کرد. در ابتدا، این شرکت از تعداد زیادی میکروفون در یک سیستم به اصطلاح شکل دهی پرتو استفاده می کرد.

با این حال، بازخورد از شرکای تجاری بالقوه این بود که سیستم به میکروفونهای بسیار زیادی نسبت به قیمت نیاز دارد تا در بسیاری از موقعیتها نتایج خوبی داشته باشد – و در بسیاری موارد دیگر کار نمیکند.

آقای مکالوین میگوید: «فرقه رایج این بود که اگر بتوانیم راهحلی ارائه کنیم که این مشکلات را حل کند، آنها بسیار علاقه مند میشوند.

و او میافزاید: “ما میدانستیم که باید راهحلی وجود داشته باشد، زیرا میتوان آن را با دو گوش انجام داد.”

این شرکت سرانجام پس از 10 سال تحقیق با بودجه داخلی این مشکل را حل کرد و در سپتامبر 2019 برای ثبت اختراع ثبت کرد.

کیت مک الوین

کیت مک الوینآنها هوش مصنوعی ابداع کردهاند که میتواند چگونگی پرش صدا را قبل از رسیدن به میکروفون یا گوش در اطراف اتاق تجزیه و تحلیل کند.

آقای مک الوین میگوید: «ما صدا را وقتی به هر میکروفون میرسد، میگیریم، برمیگردیم تا بفهمیم از کجا آمده است، و سپس اساساً هر صدایی را که نمیتوانست از جایی که فرد نشسته است صادر شود، سرکوب میکنیم.

این افکت از جهاتی قابل مقایسه با دوربینی است که روی یک سوژه متمرکز می شود و پیش زمینه و پس زمینه را تار می کند.

نتایج زمانی که شما فقط می توانید از یک ضبط آموزشی بسیار پر سر و صدا استفاده کنید واضح به نظر نمی رسند، اما هنوز هم خیره کننده هستند.

این فناوری برای اولین بار در دنیای واقعی و در یک پرونده قتل در ایالات متحده مورد استفاده قرار گرفت، جایی که شواهدی که میتوانست ارائه کند، کلید محکومیتها بود.

پس از دستگیری دو قاتل به دلیل قتل یک مرد، اف بی آی می خواست ثابت کند که آنها توسط خانواده ای که درگیر اختلاف بر سر حضانت کودک بودند، استخدام شده بودند. افبیآی خانواده را فریب داد تا فکر کنند برای شرکت در آن باجگیری شدهاند – و سپس ایستاد تا واکنش را ببیند.

در حالی که پیام های متنی و تماس های تلفنی به اندازه کافی برای FBI آسان بود تا شخصاً به آن دسترسی پیدا کند جلسات در دو رستوران موضوع دیگری است. اما دادگاه اجازه داد که از الگوریتم Wave Sciences استفاده شود، به این معنی که صدا از غیرقابل قبول به شواهد کلیدی تبدیل شد.

از آن زمان، دیگر آزمایشگاههای دولتی، از جمله آزمایشگاههای بریتانیا، مجموعهای از آزمایشها را انجام دادهاند. این شرکت اکنون این فناوری را به ارتش ایالات متحده می فروشد که از آن برای تجزیه و تحلیل سیگنال های سونار استفاده کرده است.

آقای مک الوین میگوید که این میتواند در مذاکرات گروگانگیری و سناریوهای خودکشی نیز کاربرد داشته باشد تا مطمئن شود که هر دو طرف مکالمه شنیده میشوند – نه فقط مذاکرهکننده با مگافون.

اواخر سال گذشته، این شرکت یک نرم افزار نرم افزاری را با استفاده از الگوریتم یادگیری خود برای استفاده توسط آزمایشگاه های دولتی منتشر کرد که پزشکی قانونی صوتی و تجزیه و تحلیل صوتی را انجام می دهند.

گتی ایماژ

گتی ایماژدر نهایت قصد دارد نسخه های اقتباسی از محصول خود را برای استفاده در تجهیزات ضبط صدا، رابط های صوتی داخل خودرو، بلندگوهای هوشمند، واقعیت افزوده و مجازی، سونار و سمعک معرفی کند.

بنابراین، برای مثال، اگر در یک ماشین یا یک بلندگوی هوشمند صحبت میکنید، مهم نیست که صدای زیادی در اطراف شما وجود داشته باشد، دستگاه همچنان میتواند حرف شما را بفهمد.

به گفته تری آرمنتا، مدرس پزشکی قانونی از آکادمی جرم شناسی، هوش مصنوعی در حال حاضر در سایر زمینه های پزشکی قانونی استفاده می شود.

“ML [machine learning] مدلها الگوهای صوتی را برای تعیین هویت گویندگان تجزیه و تحلیل میکنند، فرآیندی که بهویژه در تحقیقات جنایی مفید است، جایی که شواهد صوتی نیاز به تأیید اعتبار دارند.»

علاوه بر این، ابزارهای هوش مصنوعی می توانند دستکاری یا تغییر صداهای ضبط شده را تشخیص دهند و از صحت مدارک ارائه شده در دادگاه اطمینان حاصل کنند.

و هوش مصنوعی همچنین در حال نفوذ به سایر جنبه های تجزیه و تحلیل صوتی است.

بوش

بوشبوش فناوریای به نام SoundSee دارد که از الگوریتمهای پردازش سیگنال صوتی برای تجزیه و تحلیل، به عنوان مثال، صدای موتور برای پیشبینی خطا قبل از وقوع استفاده میکند.

دکتر سامارجیت داس، مدیر تحقیقات و فناوری در بوش ایالات متحده آمریکا میگوید: «قابلیتهای پردازش سیگنال صوتی سنتی فاقد توانایی درک صدا به روشی که ما انسانها هستیم، ندارند.

“هوش مصنوعی صوتی درک و تفسیر معنایی صداهای چیزهای اطراف ما – به عنوان مثال، صداهای محیطی یا سیگنال های صوتی که از ماشین ها می آید – بهتر از همیشه امکان پذیر می کند.”

آزمایشهای اخیر الگوریتم Wave Sciences نشان داده است که حتی با دو میکروفون، این فناوری میتواند به خوبی گوش انسان عمل کند – وقتی میکروفونهای بیشتری به آن اضافه میشود.

و چیز دیگری کشف شد.

“ریاضی در تمام تست های ما شباهت قابل توجهی به شنوایی انسان نشان می دهد. مکالوین میگوید: در مورد آنچه که الگوریتم ما میتواند انجام دهد و با چه دقتی میتواند آن را انجام دهد، ابهامات کمی وجود دارد که به طرز شگفتانگیزی مشابه برخی از ویژگیهایی است که در شنوایی انسان وجود دارد. .

“ما گمان می کنیم که مغز انسان ممکن است از ریاضیات مشابهی استفاده کند – که با حل مشکل مهمانی کوکتل، ممکن است به اتفاقی که در مغز می گذرد برسیم.”